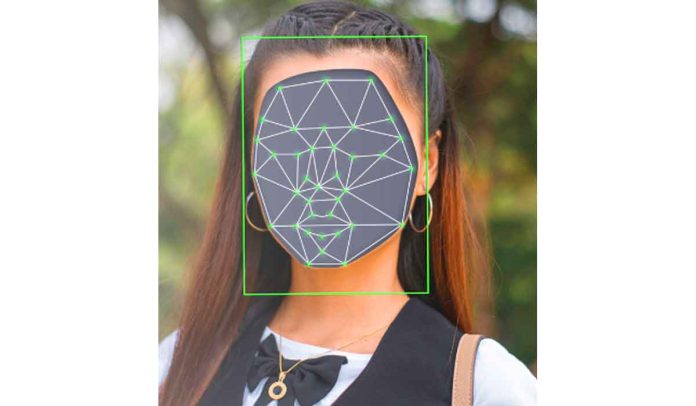

ਡੀਪਫੇਕ ਏ ਆਈ ਤਕਨੀਕ ਦੀ ਵੀਡੀਓ ਨੇ ਭਾਰਤੀ ਸਮਾਜ ਲਈ ਨਵੇਂ ਖਤਰੇ ਖੜ੍ਹੇ ਕਰ ਦਿੱਤੇ ਹਨ ਬੀਤੇ ਦਿਨੀਂ ਇੱਕ ਅਦਾਕਾਰ ਦੀ ਅਸ਼ਲੀਲ ਵੀਡੀਓ ਸਾਹਮਣੇ ਆਉਣ ਤੋਂ ਬਾਅਦ ਕਾਫ਼ੀ ਹੰਗਾਮਾ ਹੋਇਆ ਸੀ ਹੁਣ ਪ੍ਰਧਾਨ ਮੰਤਰੀ ਨਰਿੰਦਰ ਮੋਦੀ ਨੇ ਇਸ ਰੁਝਾਨ ’ਤੇ ਚਿੰਤਾ ਪ੍ਰਗਟ ਕਰਦਿਆਂ ਇਸ ਨੂੰ ਅਰਾਜਕਤਾ ਫੈਲਾਉਣ ਵਾਲੀ ਕਰਾਰ ਦਿੱਤਾ ਹੈ ਅਸਲ ’ਚ ਇਹ ਤਕਨੀਕ ਇੰਨੀ ਗਹਿਰਾਈ ’ਚ ਨਕਲੀ ਤਸਵੀਰ ਜਾਂ ਵੀਡੀਓ ਤਿਆਰ ਕਰਦੀ ਹੈ ਕਿ ਜੋ ਅਸਲੀ ਦਾ ਬਹੁਤ ਜ਼ਿਆਦਾ ਭੁਲੇਖਾ ਪਾਉਂਦੀ ਹੈ ਸਿਹਤਮੰਦ ਮਨੋਰੰਜਨ ਦੀ ਤਾਂ ਕੋਈ ਹੱਦ ਹੁੰਦੀ ਹੈ ਪਰ ਤਕਨੀਕ ਦੀ ਇਸ ਤਰ੍ਹਾਂ ਭੱਦੇ ਰੂਪ ’ਚ ਵਰਤੋਂ ਵਿਅਕਤੀ ਦੀ ਇੱਜਤ ਅਤੇ ਸ਼ਾਨ ਦੇ ਖਿਲਾਫ਼ ਹੈ ਤਕਨੀਕ ਦੇ ਦੋ ਪਹਿਲੂ ਹੁੰਦੇ ਹਨ।

ਇਸ ਦੀ ਚੰਗੀ ਤੇ ਮਾੜੀ ਦੋਵਾਂ ਤਰ੍ਹਾਂ ਵਰਤੋਂ ਹੁੰਦੀ ਹੈ ਅਸਲ ’ਚ ਕਾਨੂੰਨ ਕਾਇਦੇ ਬਣਾਉਣ ਜਾਂ ਲਾਗੂ ਕਰਨ ’ਚ ਜ਼ਿਆਦਾ ਸਮਾਂ ਲੱਗਣ ਨਾਲ ਲੋਕਾਂ ਦਾ ਸ਼ਖਸੀ ਨੁਕਸਾਨ ਹੁੰਦਾ ਹੈ ਕਿਸੇ ਦੇ ਚਰਿੱਤਰ ਨਾਲ ਖਿਲਵਾੜ ਮਾਨਸਿਕ, ਸਮਾਜਿਕ ਤੇ ਆਰਥਿਕ ਤੌਰ ’ਤੇ ਵੀ ਬਰਬਾਦੀ ਦਾ ਕਾਰਨ ਬਣਦਾ ਹੈ ਭਾਵੇਂ ਆਈਟੀ ਕਾਨੂੰਨ 2000 ਦੇ ਤਹਿਤ ਕਿਸੇ ਵਿਅਕਤੀ ਦਾ ਅਪਮਾਨ ਕਰਨ ਦੇ ਖਿਲਾਫ਼ ਕਾਰਵਾਈ ਹੋ ਸਕਦੀ ਹੈ ਪਰ ਇਸ ਕਾਨੂੰਨ ਨੂੰ ਹੋਰ ਪ੍ਰਭਾਵੀ ਢੰਗ ਨਾਲ ਮਜ਼ਬੂਤ ਕਰਨ ਤੇ ਜਾਗਰੂਕ ਕਰਨ ਤੇ ਲਾਗੂ ਕਰਨ ਦੀ ਜ਼ਰੂਰਤ ਹੈ ਇਸ ਕਾਨੂੰਨ ਦੇ ਤਹਿਤ ਦੋਸ਼ੀ ਨੂੰ ਤਿੰਨ ਸਾਲ ਦੀ ਕੈਦ ਤੇ ਦੋ ਲੱਖ ਜ਼ੁਰਮਾਨਾ ਹੋ ਸਕਦਾ ਹੈ। (Deepfake)

ਇਹ ਵੀ ਪੜ੍ਹੋ : ਗ੍ਰੇਪ ਨੂੰ ਸਖ਼ਤੀ ਨਾਲ ਲਾਗੂ ਕਰਨ ਲਈ ਛੇ ਮੈਂਬਰੀ ਟਾਸਕ ਫੋਰਸ ਬਣਾਈ

ਸੋਸ਼ਲ ਮੀਡੀਆ ਦੇ ਤੇਜ਼-ਤਰਾਰ ਯੁੱਗ ’ਚ ਅਜਿਹੀ ਤਕਨੀਕ ਦੀ ਦੁਰਵਰਤੋਂ ਹੋਰ ਵੀ ਖਤਰਨਾਕ ਹੁੰਦੀ ਹੈ ਕੁਝ ਹੀ ਸੈਕਿੰਡਾਂ ’ਚ ਵਾਇਰਲ ਹੋਈ ਵੀਡੀਓ ਦੁਨੀਆ ਭਰ ’ਚ ਵਿਅਕਤੀ ਦੀ ਸ਼ਾਨ ’ਤੇ ਦਾਗ ਲਾ ਦਿੰਦੀ ਹੈ ਅਸਲ ’ਚ ਇਹ ਮਸਲਾ ਦੂਹਰਾ ਤੇ ਗੁੰਝਲਦਾਰ ਹੈ ਤਕਨੀਕ ਦੀ ਦੁਰਵਰਤੋਂ ਦੇ ਨਾਲ-ਨਾਲ ਸੋਸ਼ਲ ਮੀਡੀਆ ਸਬੰਧੀ ਕਾਨੂੰਨਾਂ ਨਾਲ ਜੁੜਿਆ ਹੋਇਆ ਪਿਛਲੇ ਇੱਕ ਦਹਾਕੇ ਤੋਂ ਸੋਸ਼ਲ ਮੀਡੀਆ ’ਚ ਅਪਮਾਨਜਨਕ ਵੀਡੀਓ, ਆਡੀਓ ਅਤੇ ਤਸਵੀਰਾਂ ਦਾ ਗਲਤ ਰੁਝਾਨ ਰਿਹਾ ਉਸ ਸਬੰਧੀ ਮੁਲਜ਼ਮ ਖਿਲਾਫ਼ ਸਮੇਂ ਸਿਰ ਕਾਨੂੰਨੀ ਸਖ਼ਤੀ ਨਾ ਹੋਣ ਕਾਰਨ ਸ਼ਰਾਰਤੀ ਅਨਸਰਾਂ ਦੇ ਹੌਂਸਲੇ ਵਧਦੇ ਗਏ ਪ੍ਰਗਟਾਵੇ ਦੀ ਅਜ਼ਾਦੀ ਦੇ ਨਾਂਅ ’ਤੇ ਸ਼ਰਾਰਤੀ ਅਨਸਰਾਂ ਨੇ ਕਾਨੂੰਨੀ ਢਿੱਲ-ਮੱਠ ਦਾ ਫਾਇਦਾ ਉਠਾਇਆ ਹੈ। (Deepfake)

ਇਸ ਢਿੱਲ-ਮੱਠ ਨੇ ਡੀਪਫੇਕ ਜਿਹੀ ਤਕਨੀਕ ਦੀ ਦੁਰਵਰਤੋਂ ਦੇ ਵਧਣ-ਫੁੱਲਣ ਲਈ ਜ਼ਮੀਨ ਤਿਆਰ ਕੀਤੀ ਹੈ ਇਸ ਲਈ ਜ਼ਰੂਰੀ ਹੈ ਕਿ ਤਕਨੀਕ ਦੀ ਦੁਰਵਰਤੋਂ ਰੋਕਣ ਲਈ ਨੇਮਬੰਦੀ ਬਣਾਉਣ ਦੇ ਨਾਲ-ਨਾਲ ਸੋਸ਼ਲ ਮੀਡੀਆ ਦੀ ਦੁਰਵਰਤੋਂ ਰੋਕਥਾਮ ਸਬੰਧੀ ਬਣੇ ਕਾਨੂੰਨ ਦੀ ਸਮੀਖਿਆ ਕੀਤੀ ਜਾਵੇ ਸਖਤੀ ਮਨੁੱਖੀ ਮਾਨਸਿਕਤਾ ਦਾ ਅੰਗ ਹੈ ਸਖਤੀ ਨਾਲ ਹੀ ਇਸ ਮਾੜੇ ਰੁਝਾਨ ਨੂੰ ਰੋਕਿਆ ਜਾ ਸਕਦਾ ਹੈ ਇਸ ਦੇ ਨਾਲ ਹੀ ਜ਼ਰੂਰੀ ਹੈ ਕਿ ਲੋਕਾਂ ’ਚ ਜਾਗਰੂਕਤਾ ਵੀ ਪੈਦਾ ਕੀਤੀ ਜਾਵੇ ਤਾਂ ਕਿ ਫਰਜ਼ੀ ਵੀਡੀਓ ਦੀ ਪਛਾਣ ਤੁਰੰਤ ਕੀਤੀ ਜਾ ਸਕੇ। (Deepfake)